こんにちは。

東京のJです。

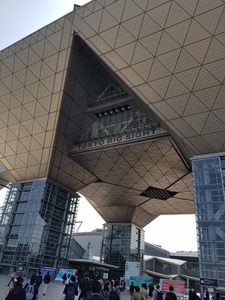

今回はTさんと東京ビッグサイトで開催中の「Japan IT Week 春」イベントに参加しました!

こちらのイベントは最新のIT製品/サービスが一堂に集まる、日本最大のIT展示会のようです。

*Japan IT Weekホームページから

*いろんなテーマで会場が切り分けられています。

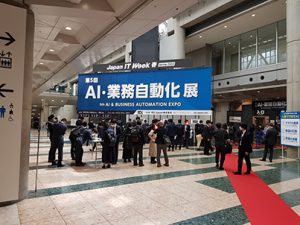

そして今回のメインターゲットは「AI・業務自動化」になります。

TさんはもともとPythonとAI関連業務が専門で、

自分はまだ実務経験どころか、まだ勉強している感じです。

AIチームで何か有用な情報を得るために来ました!

そしてなんと!

今回の写真は全部テーマにそってTさんがAI技術で顔にモザイクをかけました!

Tさんありがとうございます!

詳細の説明は割愛しますが、興味ある方は最後に添付されているソースコードを見てみてください!

※プログラムで認識できなかった横顔やマスクをつけてる顔などは手動で修正しております※

※赤い□はプログラム、黒い■は手動修正になります※

*去年のコミケ以来の東京ビッグサイト

朝9時50分に待ち合わせして、

東京ビッグサイトに入場!

人はそんなに混んでないので、

すんなり入場できました。

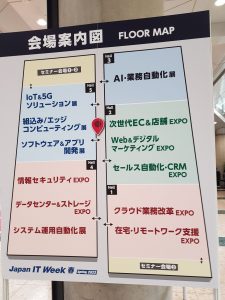

*会場案内図

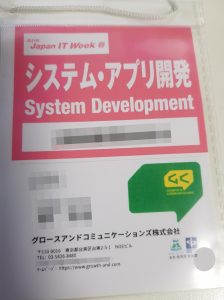

*こちらで自分の職種を選択して、

名刺を入れればバーココード付きの入場者バッジがもらえます

*入場者バッジ

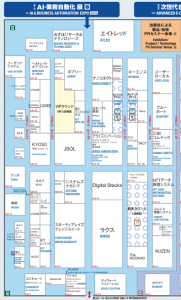

*「AI・業務自動化」会場案内図

全体案内図は大きすぎるため載せられないので、

気になる方はこちらをチェック

全体的に見たかったので、

端の方から順番に回っていきました。

*入り口

*他の会場と繋がっている

*「KARAKURI chatbot」

現在いろんなサイトでチャットボットを実際運用していますが、

個人的な経験だと、正直イマイチだと思っています。

何かあれば結局オペレーターに繋いでもらい解決することがほとんどなので、

何か新しい仕組みや機能などがあるのか気になりまして少し聞いてみました。

こちらの製品の特徴としては、

お客様が自分でチャットボットに学習させることができて、

長く学習させれば精度もだんだん上がる感じの製品でした。

*「NTT DATA」

こちらは製品の展示以外にも、

AIに関する勉強資料のようなものがたくさんありました。

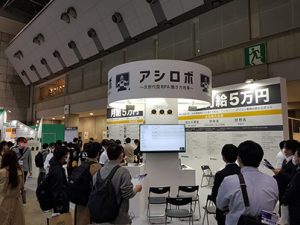

*「アシロボ」

名前通りRPA製品を提供する企業

特徴としては、シンプルでわかりやすいUI、安い月額料金などなど。

*「みずほリサーチ&テクノロジーズ」

主に製造業のAI導入事例が展示されていました。

他にもいろんな企業さんがいましたが、

業務効率化系が多い感じでした。

技術に関して情報を得たり触れたりすることが目的だったので、

営業活動に対してはなかなか受け答えに困ってしまう部分もありましたが、

それでも色々な製品を見ることが出来て良かったです。

*今回の目的と少し違う他の会場

時間が余ってたので、

面白そうな他の会場も回ってみました!

*「BRYCEN」

複数のカメラを連動して、歩行者がどの方向に移動しているか探知する技術

特殊なカメラで一定範囲内の人を探知し、その人の高さ情報を検知する設備

カメラの画像情報で3Dモデルを作る機能など

*「Hanwha Techwin」

こちらのカメラは内蔵の機能でAI顔検出ができて、

顔の領域から最高温度を表示する製品なっています。

特徴としては、カメラ一台だけで顔認識と温度チェックができるところです。

*セミナーもやっていました

*「Adobe」

Adobeのいろんなソフトしか知らなかったんですが、

こういう事業もやってるの初めて知りました

*「User Local」

SNSでいろんなデータを取り込んで分析などするサービス

*ビッグサイト退場

10時から午後2時半くらいまで回って、

Nさんと合流して少し話をして退場しました。

個人的にはもう少し技術的な物が見たかったですが、

悪くない見学になったかと思います。

興味ある方は次回参加してみたらどうでしょうか?

*左 J 右 T

アイコンはSlackのアイコンです!

ブログを全部書き終わったら気づきましたが、、

画像が自動縮小され、モザイクがかかったかあまり見えない状態になっていました、、

本当に申し訳ございません!

でも実際効果はあるので、

もし気になった方は自分で試してみてください!

最後は今回モザイク処理に使ったソースコードになります!

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 |

import cv2 import glob import os import face_recognition def main(): path = '/home/test/opencv/data' imgs = load_file(path) # path直下の画像を回す for img in imgs: result = conv_img(img) save_data(img, result) del result # path内のjpgファイルを取得 def load_file(path: str): extension = '/*.jpg' files = glob.glob(path + extension) return files # 画像ファイルを加工 def conv_img(img_path: str): # 範囲をモザイク処理 def mosaic(img, scale=0.05): mosaiced = cv2.resize(img, dsize=None, fx=scale, fy=scale, interpolation=cv2.INTER_NEAREST) h, w = img.shape[:2] mosaiced = cv2.resize(mosaiced, dsize=(w, h), interpolation=cv2.INTER_NEAREST) return mosaiced # 画像読み込み img = cv2.imread(img_path) # 画像から顔検出 locations = face_recognition.face_locations(img, number_of_times_to_upsample=2, model='hog') # 検出された顔領域に対してモザイク処理とマーカーを描画 for top, right, bottom, left in locations: img[top:bottom, left:right] = mosaic(img[top:bottom, left:right]) red = (0, 0, 255) cv2.rectangle(img, (left, top), (right, bottom), red, thickness=3) return img # 画像ファイルをresultフォルダに格納 def save_data(path: str, result): pair = os.path.split(path) result_dir = pair[0] + '/result' if not os.path.exists(result_dir): os.makedirs(result_dir) cv2.imwrite(result_dir + '/' + pair[1], result) if __name__ == "__main__": main() |